Für eine Tagung über Himmelfahrt habe ich zugesagt, einen Vortrag oder Workshop zum Thema Maschinelles Lernen und KI zu halten. Seit einigen Monaten beschäftige ich mich daher mit der Frage, wie ich dieses Thema zugänglich vermitteln kann – mit dem Ziel, die Wahrnehmung von KI ein Stück weit zu entmystifizieren, ohne daraus eine trockene wissenschaftliche Vorlesung zu machen.

Ein naheliegender Einstieg ist die Frage: Was ist KI eigentlich?

Wer sich in sozialen Netzwerken bewegt, stößt auf eine Vielzahl von Meinungen. Oft entsteht dabei der Eindruck, KI sei eine einheitliche Technologie, die alles kann. Gerade moderne Sprachmodelle verstärken dieses Bild: Sie beantworten Fragen, schreiben Texte, programmieren, liefern Rezepte oder geben sogar psychologische Ratschläge.

Dem gegenüber stehen ebenso viele Stimmen, die vor einer übermächtigen, allwissenden KI warnen. Und schließlich gibt es jene, die überzeugt sind, dass KI den Menschen in bestimmten Bereichen niemals ersetzen wird.

Um diese Spannbreite einzuordnen, lohnt sich ein nüchterner Blick.

KI ist nicht „die eine Technologie“

Unter dem Begriff KI verbirgt sich eine Vielzahl unterschiedlicher Systeme mit unterschiedlichen Ansätzen und Anwendungsfeldern. Eine allumfassende, einheitliche KI existiert nicht.

Was jedoch alle diese Systeme gemeinsam haben:

Sie reagieren auf Eingaben mit Ausgaben – und zwar so, dass diese Ausgabe mit möglichst hoher Wahrscheinlichkeit zur Eingabe passt.

In diesem Sinne kann man KI vereinfacht als eine Art Prognosemaschine verstehen.

Das gilt auch für Sprachmodelle: Sie sagen voraus, welche Antwort statistisch am besten auf eine Eingabe folgt.

Dass uns diese Systeme heute so beeindruckend erscheinen, liegt vor allem an zwei Faktoren:

- enorm gesteigerter Rechenleistung

- rasanter Fortschritt in der Entwicklung

Selbst im Vergleich zu anderen Technologiesprüngen – etwa der Verbreitung von Smartphones und Apps – verläuft die Entwicklung im KI-Bereich außergewöhnlich schnell.

Wie funktioniert KI?

Vereinfacht gesagt werden KI-Systeme trainiert. Das gilt auch für die neuronalen Netzwerke, die uns u.a. die tollen Sprachmodelle beschert haben. Neuronale Netze sind von biologischen Gehirnen inspiriert: Viele Einheiten („Neuronen“) sind miteinander verbunden und verarbeiten Signale.

Wichtig ist dabei:

Diese Systeme simulieren nicht wirklich das Gehirn, sondern nutzen ein mathematisches Modell, das auf Computern als Programm abläuft. Die rasante Entwicklung bei der Leistung von Computern hat diese Modelle inzwischen sehr leistungsfähig werden lassen.

Lernen durch Anpassung

Wie lernt ein solches System? Im Wesentlichen geht hier das Lernen über Trainieren, d.h. wir schicken eine Eingabe ins System und vergleichen die Ausgabe mit der uns bekannten richtigen Antwort. Das passiert nicht nur mit einem Datensatz, sondern mit vielen, oder sehr sehr vielen. Das Lernen passiert hier durch das Anpassen von Einstellungen in dem KI-System. Wir wiederholen dieses Training so lange, bis wir mit den Ausgaben ausreichend zufrieden sind. Und das kann durchaus lange dauern und viele Wiederholungen erfordern.

Ein stark vereinfachtes Beispiel:

- Wir haben Trainingsdaten (z. B. Bilder von Katzen und Hunden)

- Zu diesen Daten kennen wir die richtigen Antworten

- Das System erzeugt zunächst zufällige Ergebnisse

- Diese werden mit den richtigen Antworten verglichen

- Anschließend werden interne Parameter angepasst

Und wenn wir das ausreichend intensiv durchgeführt haben, kann unser Modell tatsächlich in Bildern erkennen, ob es eher eine Katze oder ein Hund ist. Aber es hat Schwierigkeiten, wenn es nun einen Vogel erkennen soll, denn das wurde nicht trainiert.

Von einfachen Aufgaben zu komplexen Systemen

Niemand braucht ernsthaft eine KI, die nur Katzen und Hunde unterscheidet. Doch mit ausreichend Daten, Rechenleistung und geeigneten Methoden entstehen daraus hochkomplexe Systeme.

Gerade bei Sprachmodellen werden Texte in kleinste Einheiten zerlegt und in mathematische Strukturen überführt. Diese bestehen aus Millionen oder Milliarden von Parametern. Diese Parameter bilden gewissermaßen das „Wissen“ des Systems – auch wenn sie für uns kaum noch intuitiv nachvollziehbar sind.

Verstehen wir KI noch?

Wir, zumindest die Experten, verstehen die grundlegenden Prinzipien von KI sehr gut. Was wir jedoch oft nicht mehr exakt nachvollziehen können, ist, warum ein konkretes Modell genau diese eine Antwort liefert.

Das wird häufig als Kritikpunkt genannt. Allerdings gilt fairerweise: Auch beim Menschen können wir nicht präzise erklären, warum jemand genau so und nicht anders entscheidet.

Mensch vs. KI – ein Vergleich

Ein Vergleich mit dem menschlichen Gehirn hilft bei der Einordnung:

| Merkmal | Menschliches Gehirn | Moderne KI-Systeme |

| Recheneinheiten | ca. 86 Milliarden Neuronen | Millionen bis Milliarden Parameter |

| Verbindungen | ca. 150–170 Billionen Synapsen | Milliarden bis Billionen Parameterverbindungen |

| Struktur | hochgradig flexibel | mathematisch optimiert |

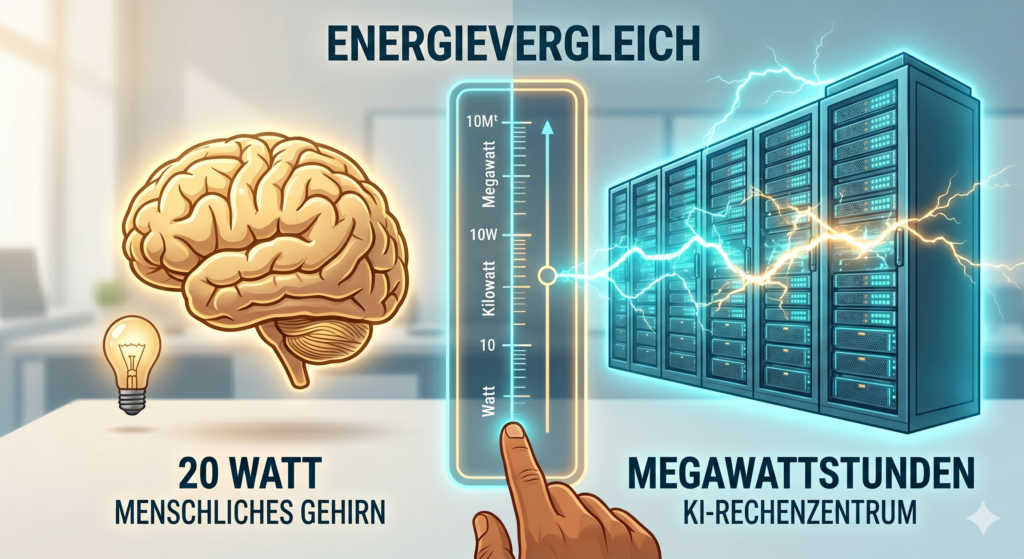

Energieeffizienz: Das 20-Watt-Wunder

Ein besonders auffälliger Unterschied liegt im Energieverbrauch:

- Das menschliche Gehirn benötigt etwa 20 Watt

- Das Training großer KI-Modelle verbraucht Megawattstunden

- Rechenzentren erreichen den Energieverbrauch kleiner Städte

Das Gehirn ist damit um Größenordnungen effizienter. Allerdings muss man schon auch anerkennen, dass zwar das Training enorm aufwändig sein kann, die Abfrage dann aber schon auch mit deutlich weniger Energieeinsatz abläuft.

Leistungsfähigkeit: Überschätzt und unterschätzt zugleich

KI-Systeme sind trotz aller Fortschritte weit von der Komplexität des menschlichen Gehirns entfernt.

Wenn man annimmt, dass Komplexität zumindest teilweise mit Leistungsfähigkeit zusammenhängt, wird klar: Eine allwissende KI ist derzeit nicht in Sicht.

Gleichzeitig gibt es Bereiche, in denen KI dem Menschen überlegen ist:

- direkte Verarbeitung digitaler Daten

- Geschwindigkeit

- Skalierbarkeit

Während Menschen Informationen erst über Sinne aufnehmen müssen, arbeiten KI-Systeme direkt mit digitalen Daten.

KI als Spezialist, nicht als Universalgenie

Aktuell sind KI-Systeme vor allem eines:hoch spezialisierte Werkzeuge

Sie können in bestimmten Aufgabenbereichen extrem leistungsfähig sein – sind aber weit davon entfernt, universell kompetent zu handeln.

Das sollte man insbesondere bei der Nutzung von Sprachmodellen im Hinterkopf behalten.

Wie steht es mit der Macht?

Damit kommen wir zur eigentlichen Frage:

Nicht „Ist KI allwissend?“

Sondern: Welche Macht geben wir ihr?

Macht bedeutet hier die Fähigkeit, reale Auswirkungen zu erzeugen. Betrachten wir ein paar Beispiele:

- Ein autonomes System bremst ein Auto → positiv

- Ein Chatbot beantwortet Kundenanfragen → effizient

- Ein fehlerhaftes System gibt gefährliche Empfehlungen → problematisch

Je mehr Kontrolle wir KI-Systemen übertragen, desto größer werden die potenziellen Risiken. Besonders kritisch wird es bei allen Systemen, die direkte Auswirkungen auf das Leben von Menschen haben oder die die Strukturen in der Gesellschaft verändern können. Im AI Act gibt es hier beispielsweise die Beschreibung der kritischen Infrastruktur. Dazu gehört unsere Energieversorgung, Kommunikationssysteme aber genau so auch der Finanzbereich. Und aus Filmen kennen wir natürlich vor allem auch militärische Anwendungen.

Es gibt aber noch viel mehr Risikobereiche, die das Leben von Menschen betreffen. So werden in Frankreich beispielsweise Studienplätze nach Erfolgsprognose einer KI zugeteilt. Wer da im falschen Viertel aufgewachsen ist, hat deutlich schlechtere Chancen. Oder denken wir daran, dass eine KI darüber entscheiden könnte, ob eine medizinische Behandlung wirtschaftlich sinnvoll ist.

Ist Human-In-The-Loop die Lösung?

Human-In-The-Loop meint hier, dass die KI nicht ohne die Kontrolle von Menschen entscheiden oder agieren darf. Bevor wir diese Frage betrachten, sollten wir uns vor Augen führen, dass auch wenn Menschen entscheiden, die Ergebnisse nicht immer wünschenswert sind. Es hängt auch hier davon ab, wer die Entscheidungen trifft und wie diese gesellschaftlich kontrolliert werden.

Wenn ein Mensch alleine über Krieg und Frieden, wirtschaftliche Entwicklungen oder die kritische Infrastruktur entscheiden kann, dann können uns diese Entscheidungen direkt ins Chaos führen.

Denn auch Menschen sind fehleranfällig, begrenzt und nicht immer rational. Und oft sind sie zudem auch noch egoistisch.

Dementsprechend kann Human-In-The-Loop auch als Kontrollinstanz verstanden werden, aber wenn es dazu führt, dass wieder nur ein Mensch alleine entscheidet, haben wir nichts gewonnen.

Und dann müssen wir auch den Faktor Zeit berücksichtigen. Human-In-The-Loop beim autonomen Fahren, wäre keine gute Idee, wenn man erstmal darüber diskutiert, ob eine Notbremsung zur Vermeidung eines Unfalls erforderlich ist.

Letztlich kann es für manche Entscheidungen sogar besser sein, wenn KI entscheidet. Es kommt halt darauf an.

Perspektive wechseln

Vielleicht ist die ursprüngliche Frage falsch gestellt. Es geht nicht darum, Angst vor einer allmächtigen KI zu haben. Die entscheidende Frage ist:

Wie gestalten wir Systeme – mit Menschen und Maschinen – so, dass Macht begrenzt und Risiken kontrollierbar bleiben?

Denn grundlegende Probleme wie Fehlentscheidungen, Machtkonzentration und die Übernahme von Verantwortung existieren völlig unabhängig vom Einsatz künstlicher Intelligenz.

Fazit

KI ist kein allwissendes Wesen und keine magische Technologie.

Sie ist ein mächtiges Werkzeug.

Und wie bei jedem Werkzeug hängt die Wirkung davon ab, wie wir es einsetzen und welche Verantwortung wir übernehmen.